Especialistas alertam: perfis com “médicos” gerados por inteligência artificial acumulam milhões de seguidores e disseminam recomendações médicas sem base científica

Uma nova fronteira da desinformação em saúde está se consolidando no Brasil e no mundo: vídeos com supostos médicos criados por inteligência artificial que oferecem conselhos médicos aparentemente profissionais — mas sem respaldo científico, responsabilidade ética ou supervisão regulatória. Isso está declarado no relatório de Feedback Científico.

O fenômeno já é alvo de investigações internacionais e acende um alerta crítico para usuários brasileiros, especialmente em um país onde temas como diabetes, obesidade e suplementação alimentar já são terreno fértil para promessas milagrosas.

Como funcionam os “médicos” de IA?

A estratégia é tecnicamente sofisticada e psicologicamente eficiente.

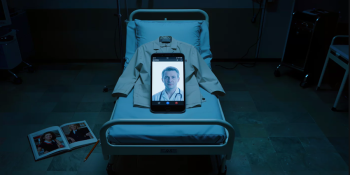

Criadores de conteúdo utilizam ferramentas de geração de vídeo e voz por IA para produzir personagens hiper-realistas vestidos como médicos, em ambientes clínicos simulados. Esses “profissionais”:

Falam com autoridade técnica;

Utilizam jargões médicos;

Citam sintomas comuns;

Oferecem soluções simples e rápidas.

Muitos vídeos afirmam, por exemplo, que:

Sono ruim e desejo por doces seriam sinais claros de “excesso de açúcar no sangue”;

Cúrcuma poderia substituir medicamentos no controle da glicemia;

Certos suplementos naturais “regenerariam” o pâncreas.

Do ponto de vista clínico, tais afirmações são reducionistas e potencialmente perigosas. Sintomas como fadiga, compulsão alimentar ou insônia são inespecíficos e não permitem diagnóstico isolado. Além disso, nenhum suplemento substitui o tratamento estruturado do diabetes, que envolve acompanhamento médico, exames laboratoriais e, quando necessário, farmacoterapia validada.

O modelo de negócio por trás da fraude

Esses perfis não surgem por acaso. Há uma engenharia de monetização clara:

Crescimento acelerado por meio de conteúdo viral;

Alcance dos critérios de monetização das plataformas;

Venda de suplementos, e-books ou “protocolos naturais”;

Possível revenda das contas já engajadas.

Algumas contas acumulam centenas de milhares de seguidores e milhões de visualizações. Plataformas como TikTok exigem metas mínimas de seguidores e visualizações para liberar monetização — metas que esses perfis frequentemente atingem.

Além da receita direta, páginas populares podem ser posteriormente utilizadas em golpes mais complexos, inclusive esquemas de phishing ou venda de produtos sem registro sanitário.

O uso indevido da imagem de médicos reais

Casos internacionais revelaram ainda o uso de deepfakes com a imagem de médicos reais, incluindo especialistas conhecidos em emagrecimento e ortopedia. Profissionais tiveram seus rostos e vozes replicados digitalmente sem autorização.

Esse tipo de manipulação gera dois efeitos graves:

Danos à reputação de profissionais legítimos;

Confusão pública sobre o que é informação médica confiável.

No Brasil, onde o Conselho Federal de Medicina regula rigorosamente a publicidade médica, a replicação digital não autorizada pode configurar infração ética e crime.

Por que essa estratégia funciona?

A confiança é o ativo central da medicina. Estudos em psicologia social mostram que:

Autoridade percebida aumenta adesão à mensagem;

Uniformes e cenários clínicos elevam credibilidade;

Linguagem técnica reduz questionamento crítico.

Quando um conteúdo combina esses elementos com edição profissional e alto número de seguidores, o cérebro interpreta aquilo como validado socialmente.

Isso é particularmente preocupante entre idosos — grupo estatisticamente mais vulnerável à desinformação online — mas não se restringe a eles. Jovens também são impactados, sobretudo no campo da estética, emagrecimento e suplementação.

Riscos reais para a saúde pública

A disseminação de conselhos médicos imprecisos pode gerar:

Abandono de tratamento convencional;

Uso inadequado de suplementos;

Interações medicamentosas perigosas;

Atraso no diagnóstico de doenças crônicas;

Desconfiança generalizada em profissionais legítimos.

Em termos de saúde pública, o impacto vai além do indivíduo. Desinformação sistemática compromete políticas de prevenção, adesão terapêutica e até campanhas de vacinação.

Como identificar um “médico” falso gerado por IA

Alguns sinais de alerta incluem:

Movimentos faciais levemente artificiais;

Sincronização labial imperfeita;

Falta de identificação profissional verificável;

Promessas de cura rápida;

Ausência de referências científicas;

Incentivo direto à compra de produtos.

Antes de confiar em qualquer orientação médica nas redes sociais:

Verifique o número de registro profissional (CRM);

Busque o nome do profissional em fontes oficiais;

Consulte seu médico antes de alterar qualquer tratamento.

O papel do leitor brasileiro

No Brasil, onde o consumo de conteúdo de saúde nas redes é massivo, o senso crítico é uma ferramenta de proteção individual e coletiva.

A alfabetização digital em saúde — ou seja, a capacidade de avaliar criticamente informações médicas online — torna-se uma competência essencial do século XXI.

A tecnologia de inteligência artificial não é, por si só, o problema. O risco está na sua aplicação sem ética, sem regulação e com finalidade comercial predatória.

A pergunta que precisa ser feita não é apenas “isso parece verdadeiro?”, mas sim:

Quem se beneficia se eu acreditar nisso?

Nossa Opinião:

Os “médicos” criados por inteligência artificial representam uma nova geração de desinformação: visualmente convincente, emocionalmente persuasiva e economicamente estruturada.

O enfrentamento desse fenômeno exige:

Regulação mais eficaz das plataformas;

Fiscalização sanitária rigorosa;

Educação digital da população;

Responsabilização de fraudadores.

Enquanto isso, a regra permanece simples e inegociável: orientação médica válida é aquela feita por profissional habilitado, com identificação verificável e baseada em evidências científicas.

Na era da inteligência artificial, discernimento é questão de saúde.

Vídeos da notícia

Imagens da notícia

Documentos da notícia

Notícias relacionadas

Mais vídeos relacionados

-

Resgate de volta a um corpo mais leve

01/04/2026 -

Adoçantes? Não cometa esse erro!

01/04/2026 -

Dona Célia no Receitas saudáveis

01/04/2026 -

Sementes? Não Escolha, Combine!

24/03/2026